Der Einsatz von Künstlicher Intelligenz (KI) gewinnt im Bankensektor zunehmend an Bedeutung, von effizienteren Prozessen über verbesserte Entscheidungsunterstützung bis hin zu erweiterten Analysekapazitäten in der Banksteuerung. Gleichzeitig entstehen durch KI ökologische, soziale und Governance-bezogene Risiken, deren Auswirkungen oft erst mittel- bis langfristig sichtbar werden. Publikationen internationaler Institutionen, wie etwa der OECD, zeigen, dass KI-Anwendungen in Kreditinstituten bereits in mehreren Kernprozessen eingesetzt werden, insbesondere im Risikomanagement, in der Betrugsprävention und im Kundenservice, auch wenn der Reifegrad und die Einsatzbreite je nach Institut stark variieren. Auch Aufsichtsbehörden nutzen zunehmend KI, wie ein IWF Paper belegt, was mittelbar den Erwartungsdruck auf Institute erhöhen dürfte.

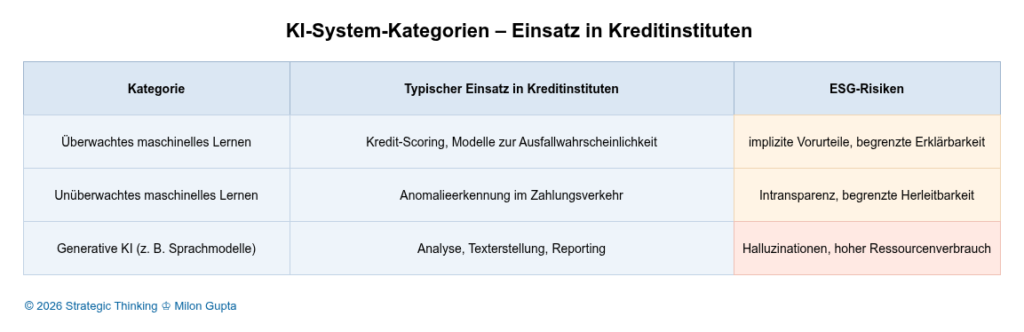

Je nach Einsatzbereich werden unterschiedliche Arten von KI-Systemen verwendet. Machine-Learning-Verfahren sind in Bereichen wie Kredit-Scoring und Betrugserkennung seit Jahren fester Prozessbestandteil. Der Einsatz generativer KI ist dagegen bishernoch begrenzt, da deren Verwendung im Regelbetrieb noch schwierige technische und regulatorische Fragen aufwirft.

Abbildung 1: KI-System-Kategorien – Einsatz in Kreditinstituten (zum Vergrößern Bild anklicken)

Hinter dem Oberbegriff KI stehen im Bankenkontext üblicherweise drei Kategorien von KI-Systemen (siehe Tabelle): überwachtes maschinelles Lernen, unüberwachtes maschinelles Lernen und generative KI, zu der große Sprachmodelle gehören. Die ESG-Risiken in den jeweiligen Kategorien können sich im Einzelfall erheblich unterscheiden, je nach Datenbasis, KI-Modell, Einsatzkontext und Governance.

Damit wird die Frage zentral, wie Kreditinstitute KI-Systeme so einsetzen können, dass Effizienz- und Steuerungsvorteile realisiert werden, ohne ökologische Belastungen, soziale Risiken oder Governance-Defizite zu schaffen oder zu verstärken. Dafür ist ein systematisches Vorgehen erforderlich, das Chancen und Risiken entlang der ESG-Dimensionen erfasst, bewertet und in bestehende Steuerungs- und Kontrollsysteme integriert.

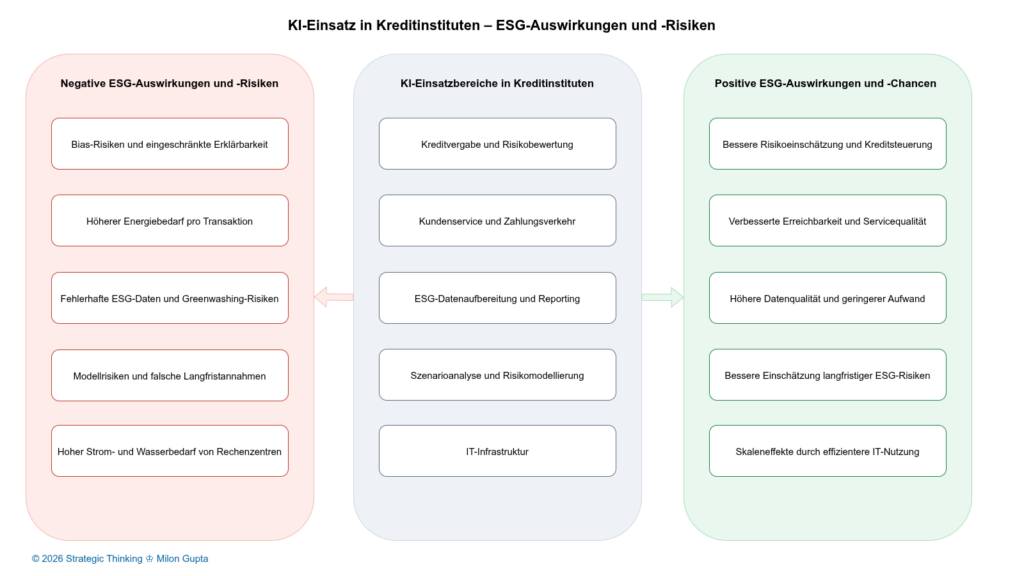

ESG-Herausforderungen beim Einsatz von KI in Kreditinstituten

Die folgenden Einsatzfelder erheben keinen Anspruch auf Vollständigkeit. Sie geben aber einen realistischen Einblick in die vielfältigen ESG-relevanten Herausforderungen von KI-Anwendungen im Finanzsektor.

Abbildung 2: KI-Einsatz in Kreditinstituten – ESG-Auswirkungen und -Risiken (zum Vergrößern Bild anklicken)

Kreditvergabe und Risikobewertung

In der Kreditvergabe und Risikobewertung werden KI-gestützte Verfahren eingesetzt, um Bonitätsbeurteilungen zu automatisieren, Risiken granularer zu differenzieren und Entscheidungsprozesse effizienter zu gestalten. So können insbesondere überwachte Machine-Learning-Modelle eine höhere Prognosegüte erreichen als klassische statistische Verfahren. Sie bergen aber gleichzeitig soziale und Governance-Risiken: Verzerrungen in Trainingsdaten können diskriminierende Effekte verstärken. Komplexe Modelle verringern oft die Nachvollziehbarkeit einzelner Entscheidungen.

Regulatorisch ist dieser Einsatzbereich besonders sensibel. Der 2024 verabschiedete EU AI Act regelt KI-Systeme auf risikobasierter Grundlage und stuft Kreditwürdigkeitsprüfungen in den Bereich der Hochrisiko-KI-Systeme ein. Diese sind an strenge Anforderungen geknüpft, etwa hinsichtlich Datenqualität, Dokumentation, Transparenz und menschlicher Aufsicht.

Damit KI in Kreditprozessen insgesamt zu stabileren Entscheidungen beiträgt ohne mit dem AI Act in Konflikt zu kommen, sollte sie primär zur Entscheidungsunterstützung eingesetzt werden. Dafür sind gezielte Maßnahmen zur Risikominderung erforderlich. Dazu gehören klare Einsatzgrenzen, möglichst nachvollziehbare Modelllogik, starke Validierungs- und Monitoringprozesse sowie klar festgelegte Verantwortlichkeiten.

Kundenservice und Zahlungsverkehr

Im Kundenservice wird KI häufig in Form von Chatbots und Voicebots genutzt, um Antworten auf Standardanfragen zu automatisieren und eine Verfügbarkeit rund um die Uhr zu ermöglichen. Im Zahlungsverkehr und besonders bei Anomalie- und Betrugserkennung kommen Machine-Learning-Prozesse zum Einsatz, um Muster in Transaktionsdaten in nahezu Echtzeit zu erkennen.

Den Effizienzgewinnen aus dem Einsatz von KI im Kundenservice stehen potenziell signifikante ökologische und soziale Auswirkungen gegenüber. Echtzeit-Überwachung erhöht die Rechenlast und damit den Energiebedarf. Zudem besteht im sozialen Bereich die Gefahr indirekter Exklusion, wenn KI-gestützte Self-Service-Kanäle zum Standard werden und alternative Zugangswege faktisch an Bedeutung verlieren oder mit längeren Wartezeiten verbunden sind. Datenschutz- und Transparenzfragen sind in diesem Kontext zentral, weil Kundendaten in großem Umfang verarbeitet werden. Das European Data Protection Board hatte dazu bereits 2018 in seinen Leitlinien zu automatisierten Entscheidungen und Profiling Empfehlungen gegeben.

Die positiven Effekte von KI zeigen sich dort, wo sie in der Praxis zu weniger Betrugsfällen und geringeren Schäden führt. Um die Vorteile zu realisieren und die Nachteile zu minimieren ist ein Mix an Maßnahmen sinnvoll: Reduktion unnötiger Rechenlast, Bias-Checks (z. B. bei False Positives), klare Kundenkommunikation sowie operative Kontrollen, die das Modellverhalten im Zeitverlauf überwachen.

ESG-Datenaufbereitung und Reporting

Die Aufbereitung von ESG-Daten ist in Kreditinstituten oft durch heterogene Datenquellen, Datenlücken und Inkonsistenzen geprägt. KI kann helfen, unstrukturierte Informationen, beispielsweise aus Nachhaltigkeitsberichten von Firmenkreditnehmern, zu extrahieren, zu strukturieren und auf Plausibilität zu prüfen. Das funktioniert insbesondere dann, wenn klar definierte Datenmodelle und Qualitätsregeln existieren.

Mit wachsendem regulatorischen Reporting- und Prüfungsdruck steigen auch die Governance-Risiken: Werden Datenquellen, Annahmen, Extraktionslogiken und Prüfpfade nicht dokumentiert, drohen Audit- und Reputationsrisiken. Bei generativer KI kommt außerdem das Risiko von Halluzinationen hinzu, überzeugend formulierten Aussagen, die frei erfunden sind. Ohne systematische Human-in-the-Loop-Prüfung kann bereits eine geringe Zahl KI-generierter Faktenfehler Effizienzgewinne konterkarieren.

Damit KI in der ESG-Datenaufbereitung tatsächlich einen Nettonutzen erzeugt, braucht es klare Regeln: vorher geprüfte und ausgewählte Quellen, Nachvollziehbarkeit der Datenkette, definierte Qualitätsmetriken, dokumentierte Prüfprozesse sowie klar geregelte Rollen und Verantwortlichkeiten.

Szenarioanalyse und Risikomodellierung

KI eröffnet neue Möglichkeiten, komplexe Risikoentwicklungen zu analysieren. Dazu gehören beispielsweise nichtlineare systemdynamische Entwicklungen in Klimaszenarien, wie etwa denen des Network for Greening the Financial System (NGFS), oder kombinierte makroökonomische Schocks. Gleichzeitig steigt die Modellkomplexität. Das erschwert Validierung, Interpretation und die Integration in bestehende Steuerungsprozesse, einschließlich dem Management von Modellrisiken.

Gerade bei ESG-Risiken mit langen Zeithorizonten besteht die Gefahr der Scheingenauigkeit: Modelle können exakte Zahlen liefern, obwohl die Ausgangsdaten hohe Unsicherheiten beinhalten. Das Network for Greening the Financial System (NGFS) betont, dass Szenarien als Wenn-dann-Logik zu verstehen sind und nicht als Prognosen mit Wahrscheinlichkeiten. Die Ergebnisse sind also immer als kontextabhängige mögliche Entwicklungen zu betrachten.

Schlussfolgerung: KI-gestützte Szenarien sind sinnvoll als Ergänzung, nicht als Ersatz fachlicher Bewertung. Governance-seitig sollten Unsicherheiten explizit ausgewiesen, Modellgrenzen dokumentiert und qualitative Einordnungen systematisch verankert werden.

IT-Infrastruktur

Die IT-Infrastruktur bildet die Grundlage aller KI-Anwendungen. Rechenzentren, Cloud-Dienste und spezialisierte Hardware verursachen ökologische Belastungen durch Energie- und Wasserverbrauch im laufenden Betrieb sowie durch den Ressourcenbedarf in der Hardware-Produktion. Die Internationale Energieagentur (IEA) weist in ihrem Bericht „Energy and AI“ (April 2025) darauf hin, dass KI-Workloads ein zentraler Treiber des steigenden Energiebedarfs von Rechenzentren sind.

Für Kreditinstitute ergeben sich daraus zwei zentrale Steuerungshebel: erstens Transparenz und Steuerung des Infrastruktur-Fußabdrucks, etwa über Energiequellen, Effizienzkennzahlen und Workload-Optimierung; zweitens konsequente Governance von Beziehungen zu IT-Dienstleistern und -Lieferanten, einschließlich der Aspekte Datensouveränität und Konzentrationsrisiken bei großen Cloud-Anbietern (siehe EZB-Leitlinien für Cloud-Outsourcing).

Thesen zum nachhaltigen Einsatz von KI in Kreditinstituten

Die dargestellten Herausforderungen zeigen, dass der ESG-konforme Einsatz von KI eine komplexe Steuerungsaufgabe darstellt. Dabei gilt es Technologie, Prozesse, Daten, Mitarbeitende und Dienstleister in einer ESG-konformen, institutsindividuellen KI-Strategie zu integrieren. Auch wenn es keine allgemein anwendbare KI-Strategie für alle Institute gibt, möchte ich hierzu folgende Thesen als Anregung zur weiteren Diskussion aufstellen:

These 1: ESG-positive Effekte von KI entstehen primär durch Entscheidungsunterstützung, nicht durch Vollautomatisierung.

Dort, wo KI die Mitarbeitenden unterstützt, etwa bei Priorisierung, Plausibilisierung oder Mustererkennung, können Institute bei entsprechender Ausgestaltung Effizienzgewinne erzielen, ohne Governance- und Sozialrisiken unnötig zu erhöhen.

These 2: Nachhaltiger KI-Einsatz ist in erster Linie eine Governance-Frage und nur in zweiter Linie eine Technologiefrage.

Governance entscheidet primär darüber, wie nachhaltig Institute KI einsetzen. Dazu gehören Transparenz, klar definierte Verantwortlichkeiten, dokumentierte Einsatzgrenzen, Validierung, Monitoring und Auditierbarkeit. Sie entscheiden darüber, ob KI im Bankbetrieb beherrschbar bleibt. Die Regulierung in Form von AI Act und DSGVO stellt in diesem Kontext hohe Anforderungen. Die technologische Umsetzung ist für die Nachhaltigkeit ebenfalls wichtig. Sie ist aber nur möglich auf der Grundlage einer ausgereiften KI-Governance.

These 3: ESG-Risiken von KI entstehen zu einem erheblichen Teil außerhalb des Instituts.

Ein großer Teil der ökologischen und sozialen Auswirkungen hängt an Rechenzentren, Datenquellen und Modellen externer Anbieter. Entsprechend sind Beschaffungs- und Outsourcing-Strategien von zentraler Bedeutung, um extern verursachte ESG-Risiken in der KI-Wertschöpfungskette zu minimieren. Die Einkaufs-, Auslagerungs- und Digitalstrategien von Instituten sollten daher ESG-Aspekte von KI systematisch integrieren. Wie die BaFin betont, ist Transparenz der Schlüssel zum sicheren Einsatz von KI-Leistungen Dritter.

Fazit

Den KI-Einsatz auszubauen bietet Kreditinstituten erhebliche Chancen, Prozesse effizienter zu gestalten und ein präziseres Steuerungsniveau zu erreichen. Gleichzeitig entstehen ESG-Risiken, die ohne robuste Governance, bewusste Modellnutzung und transparente Infrastrukturentscheidungen zu negativen ökologischen und sozialen Auswirkungen führen können. Nachhaltiger KI-Einsatz bedeutet daher nicht maximale Nutzung wo immer technisch möglich, sondern gezielte und kontrollierte Integration in bestehende Risiko- und Steuerungssysteme.

Nächste Schritte

Der KI-Einsatz im Bankenumfeld wirft zunehmend Fragen auf, die über Technik und Effizienz hinausgehen: Wie lassen sich ESG-Ziele, regulatorische Anforderungen und wirtschaftliche Erwartungen in Einklang bringen? Welche Use Cases liefern nachhaltigen Mehrwert? Und wo entstehen neue ESG- und Modellrisiken, die in der Planung, einschließlich der ESG-Risikoplanung, systematisch berücksichtigt werden sollten?

Wenn Sie dazu Ihre Perspektive teilen oder Erfahrungen aus der Praxis diskutieren möchten, freue ich mich über einen Austausch. Wenn Sie möchten, stehe ich auch gern für ein unverbindliches Gespräch zur Verfügung, wie ich Sie bei der Entwicklung einer ESG-konformen KI-Strategie unterstützen könnte. Schreiben Sie mir.